Enkele maanden geleden werden al de eerste details en screenshots van 3DMark06 bekendgemaakt, maar vandaag heeft Futuremark definitief zijn nieuwe benchmarksuite gelanceerd. De nieuwe versie van het bekende testprogramma biedt diverse verbeteringen ten opzichte van 3DMark05. Zo heeft Futuremark de onderliggende 3d-engine verbeterd, complexere ShaderModel 2.0- en HDR ShaderModel 3.0-tests toegevoegd en substantieel meer polygonen gebruikt. Futuremark verwacht dat games pas over twee jaar hetzelfde aantal polygonen zullen gebruiken als 3DMark06. Ondanks het gebruik van twee ShaderModel 3.0-tests, kunnen eigenaren van ShaderModel 2.0-videokaarten dankzij twee SM 2.0-tests ook een 3DMark06 score verkrijgen. Net als 3DMark05 is het nieuwe Futuremark-programma in verschillende versies beschikbaar. Alle versies ondersteunen aparte tests voor gpu's en cpu's, waarbij ook multithreaded cpu-tests kunnen worden uitgevoerd om het hele spectrum aan processors op waarde te kunnen schatten.

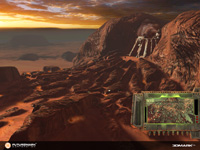

De volledige benchmark bestaat weer uit een aantal verschillende onderdelen. Zo zijn er vier grafische tests te bewonderen: de SM 2.0-tests 'Return to Proxycon' en 'Firefly Forest' zullen gebruikers van 3DMark05 bekend voorkomen, en ook de SM 3.0-test 'Canyon Flight' is een oude bekende. De laatste grafische test is wederom bedoeld om SM 3.0 te testen en heeft de naam 'Deep Freeze'. Terwijl in de vorige versie van 3DMark cpu's nog getest werden door de eerste drie benches in 640x480 met software vertex shaders te draaien, zijn er nu twee speciale cpu-tests die 'Red Valley' gedoopt zijn. Uiteraard wordt het geheel aangevuld met een batterij synthetische benchmarks. Nieuw hierbij zijn twee SM 3.0-tests, die 'Shader Particles Test' en 'Perlin Noise' zijn genoemd.

3DMark06 is het eerste product van Futuremark dat gebruik maakt van AGEIA's PhysX-software, die wordt ingezet voor de cpu-tests. Omdat nieuwe spellen steeds geavanceerdere kunstmatige intelligentie en complexere physics gebruiken, zullen volgens Futuremark multithreaded processors steeds belangrijker worden. Door de resultaten van de nieuwe cpu-tests met die van de vier grafische tests te combineren, zou met 3DMark06 ook van de prestaties van de komende generaties hardware een goed beeld gegeven moeten kunnen worden.

Naast een gratis editie is er ook een 'advanced'-versie, die net geen twintig dollar kost, en een 'professional'-variant waar 490 dollar voor moet worden neergeteld. Voor een torrent-bestand en een lijstje met mirrors waar de 577MB grote download te vinden is, kan je in de Meuktracker terecht terecht. Om de tests enigszins uit de verf te laten komen, beveelt Futuremark een computer met de volgende specificaties aan:

- Intel- of AMD-compatibele processor, 2.5GHz or hoger

- DirectX 9-compatibele videokaart met minimaal Pixel Shader 2.0-ondersteuning, en tenminste 256MB videogeheugen

- 1GB intern geheugen en 1,5GB ruimte op de harde schijf

- Windows XP met de laatste Service Packs en updates

- DirectX 9.0c van december 2005 of later

/i/1209394382.png?f=fpa)

:strip_exif()/i/1045000502.jpg?f=fpa)