X-bit Labs heeft zichzelf de taak gesteld om uit te vinden wat de invloed van de processor op de prestaties van spellen is. Gewapend met maar liefst 28 processors en 5 van de zwaarste spellen van dit moment (Battlefield 2, Call of Duty 2, F.E.A.R., Quake 4 en Serious Sam 2) is men het testlab ingedoken. Als videokaart koos men voor een GeForce 7800 GT; niet de snelst beschikbare, maar toch bovengemiddeld en ruim voldoende om de genoemde spellen mee te kunnen spelen. Naast het effect van de processors wordt ook de stap van 1GB naar 2GB geheugen geëvalueerd. In het eerste deel van de beschouwing richt men zich vooral op situaties waarin het verschil tussen de processors goed te merken is. Het tweede deel test wat minder verschillende processors, maar gebruikt instellingen die wat realistischer zijn voor normaal gebruik. In dit artikel worden beide delen samengevat.

![]() Battlefield 2

Battlefield 2

Battefield 2 wordt in een resolutie van 1024x768 met Medium-instellingen gedomineerd door AMD. Intels duurste gameprocessor, de 3,73GHz Extreme Edition, kan net een goedkope 2GHz Athlon 64 3200+ bijhouden. Het topmodel van AMD, de 2,8GHz FX-57, is echter nog eens 70% sneller dan dat en laat de concurrentie dus ver achter zich. Omdat dit spel geen tweede core kan gebruiken hoeft daar niet naar gekeken te worden. Opvallend is wel dat de Athlon in deze test meer heeft aan een groter L2-cache dan de Pentium 4. Wanneer de instellingen worden verhoogd naar 1280x1024 met 4x AA en de instellingen op High Quality verandert het beeld drastisch: in de top blijft alles steken rond dezelfde score, waaruit heel duidelijk blijkt dat de videokaart de beperkende factor wordt. Hoewel AMD nog wel aan kop staat maakt het eigenlijk nauwelijks uit welke processor er gebruikt wordt, zolang het maar geen Celeron of oude Sempron is.

![]() F.E.A.R.

F.E.A.R.

Deze 3d-shooter laat minder extreme verschillen zien dan Battlefield in de test met mindere instellingen. Op Medium (zonder anti-aliasing en trilinear filtering) is het verschil in prestaties tussen de traagste en snelste processor slechts 30%, en geen enkele chip scoort onder de 100 frames per seconde. Een tweede core wordt ook hier niet gebruikt. Wanneer de kwaliteit naar Maximum wordt gezet zakken de framerates natuurlijk in, maar dit maakt het verschil tussen de processors alleen maar kleiner. Een Celeron D 326 (2,53GHz) haalt 43 fps en de 2,8GHz Athlon 64 FX doet er 44 per seconde. Al met al geldt ook voor dit spel dat geen zin heeft om er een snelle processor voor te kopen.

![]() Serious Sam 2

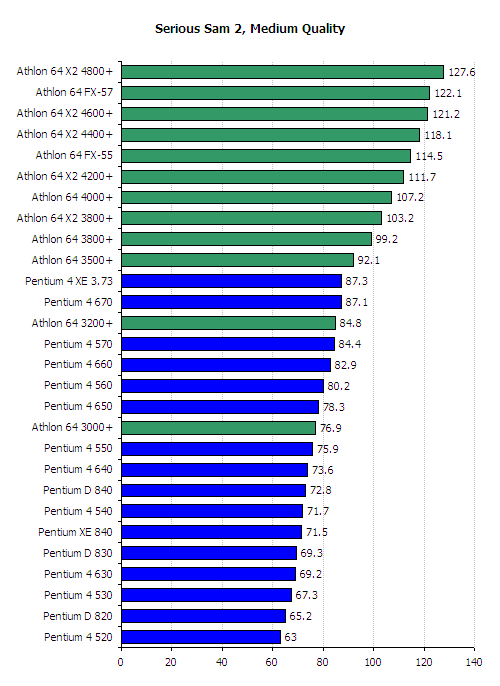

Serious Sam 2

Voor serieuze Sam liggen de verwachtingen hoog; het spel gebruikt erg veel natuurkundige berekeningen en zou daardoor zelfs op hoge instellingen nog steeds deels CPU-afhankelijk zijn. Met 'Medium' instellingen komt in ieder geval het beeld van Battlefield 2 terug: de AMD-chips veroveren de hele top tien en aan de onderkant van de grafiek komen we alleen nog maar Pentiums tegen. Opvallend is hier echter hoe goed de dual-core Athlon 64 X2 het doet. Het spel weet goed gebruik te maken van de tweede AMD-core en de 2,8GHz FX wordt er dus uitgetrokken door een 2,4GHz X2. Intels dual-core Pentium D daarentegen lijkt op geen enkele manier van dezelfde optimalisaties te profiteren. Ondanks de tweede core presteert de Pentium D hetzelfde als een gelijk geklokte single-core Pentium 4, en dat is natuurlijk een grote teleurstelling.

In een hogere resolutie (1280x1024) met vier keer AA ingeschakeld en de instellingen op 'Maximum' verdwijnen ook in Serious Sam de grootste verschillen. De vele malen duurdere en veertig procent hoger geklokte Athlon 64 FX-57 doet het bijvoorbeeld maar krap 7% beter dan de 3200+.

![]() Quake 4, Call of Duty 2

Quake 4, Call of Duty 2

Ook Quake 4 is een spel dat gebruik weet te maken van de tweede core in dual-corechips. In tegenstelling tot Serious Sam weet Quake echter zowel de Athlon 64 X2 als de Pentium D te benutten. Toch geeft AMD in dit geval meer waar voor zijn geld: de Pentium EE 840 (dual-core 3,2GHz) presteert namelijk ongeveer hetzelfde als single-core Pentium 4 3,6GHz of een 2,0GHz Athlon 64 X2 3800+. De verschillen tussen de processors in Quake zijn overigens sowieso kleiner dan die in Serious Sam 2. De shooter Call of Duty 2 weet net als Quake 4 de tweede core van beide merken te benutten, maar ook dit spel is weer duidelijk door de videokaart beperkt, waardoor het eigenlijk niet zo interessant is om te bespreken.

![]() Conclusies

Conclusies

De conclusie is duidelijk: gamers met een beperkt budget kunnen hun geld beter investeren in een goede videokaart dan in een snelle processor. Een spotgoedkope Celeron of Sempron zal natuurlijk nog wel een beperkende factor vormen, maar in principe is iedere mainstream desktopchip al genoeg voor zelfs de zwaarste games. Een high-end Athlon FX of Pentium Extreme Edition kan nog altijd wel iets toevoegen aan prestaties, maar wie het geld daar niet voor over heeft zal er ook weinig aan missen.

Opvallend is dat spellen nu al van dual-core beginnen te profiteren. In eerste instantie was het voor gamers eigenlijk alleen maar interessant om hier naar te kijken als ze klaar wilden zijn voor de toekomst of ook andere dingen met hun systeem wilden doen. Nu is dual-core in sommige gevallen echter al de beste manier geworden om hoge framerates neer te zetten. In hoeverre dat nou komt door optimalisaties in de spellen zelf of door nieuwe multithreaded drivers is nog niet helemaal duidelijk, maar het effect is in ieder geval wel zichtbaar.

Opvallend is dat spellen nu al van dual-core beginnen te profiteren. In eerste instantie was het voor gamers eigenlijk alleen maar interessant om hier naar te kijken als ze klaar wilden zijn voor de toekomst of ook andere dingen met hun systeem wilden doen. Nu is dual-core in sommige gevallen echter al de beste manier geworden om hoge framerates neer te zetten. In hoeverre dat nou komt door optimalisaties in de spellen zelf of door nieuwe multithreaded drivers is nog niet helemaal duidelijk, maar het effect is in ieder geval wel zichtbaar.

Een deur die wagenwijd open staat is dat AMD voor gamers nog steeds interessanter is dan Intel. De Pentiums moeten het maar al te vaak afleggen tegen hun concurrenten, en hoewel de eerste conclusie is dat de snelheid van de processor eigenlijk niet zo heel veel uitmaakt, geeft de prijs/prestatieverhouding van de Athlons vaak toch de doorslag.

Naast de processors heeft X-bit ook bij ieder spel gekeken wat het effect is van de stap van 1GB naar 2GB geheugen. In geen enkel spel was er een heel overtuigend resultaat te zien van deze investering: de toename in framerate bleef beperkt tot enkele procenten. Toch zegt de reviewer in sommige gevallen - met name Battlefield 2 - wel dat het gevoelsmatig sneller gaat, omdat er minder naar de harde schijf geswapt hoeft te worden. Ook hier geldt voor de gamer met een budget dus dat er beter in de videokaart geïnvesteerd kan worden.

:fill(white):strip_exif()/i/2000831576.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831539.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/1286780887.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831547.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831618.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831566.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831605.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831633.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831585.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831621.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831546.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831549.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831557.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831548.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000831553.jpeg?f=thumbmedium)

:strip_exif()/i/1118165322.jpg?f=thumbmedium)