AMD ontwikkelt een desktop-processor met zes cores, genaamd Thuban. De cpu's passen op een AM3-socket en zullen waarschijnlijk in het derde kwartaal van 2010 op de markt komen. Dat is na de verschijning van Intels Gulftown-cpu's.

Thuban staat in het Arabisch voor 'draak' en is tevens de naam van een ster in het Draco-sterrencluster. De aldus genoemde hexacore van AMD krijgt een ddr3 1333MHz-geheugencontroller, 3MB L2-cache en 6MB L3-cache. Waarschijnlijk komen de 45nm-chips uit onder de Phenom II-vlag, maar het ontwerp is gebaseerd op de Istanbul-processors voor servers. Het gaat om AM3-cpu's die mogelijk ook op een AM2+-voetje met split power plane passen. Volgens bronnen van Xbit-labs wordt de Thuban-processor in het derde kwartaal van 2010 leverbaar. Dat is na de komst van Intels Gulftown; deze 32nm-hexacore met ondersteuning voor hyperthreading komt in het tweede kwartaal van 2010 uit, mogelijk als Core i9-model. De Gulftown moet worden gecombineerd met X58-chipset.

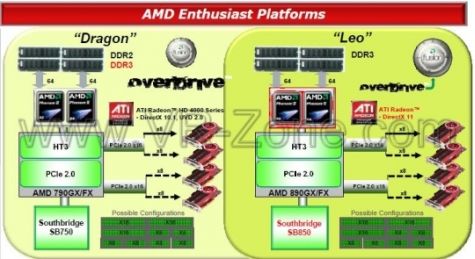

Onduidelijk is nog of de Thuban-cpu deel gaat uitmaken van de opvolger van AMD's Dragon-platform, dat in april 2010 moet verschijnen. Dit platform, dat de naam Leo gaat dragen, zal bestaan uit AM3-multicores die sneller zijn dan de huidige generatie, in combinatie met de AMD 890FX/GX-chipset en de SB850-southbridge. Daarnaast moeten systemen die de naam Leo willen dragen een DirectX 11-videokaart van het type Cypres of Hemlock, oftewel HD 5870 en HD 5870 X2 bevatten. In tegenstelling tot Dragon kan Leo alleen met ddr3-geheugen gecombineerd worden. Het Leo-platform krijgt onder meer uitgebreidere Crossfire-mogelijkheden, waaronder een nieuwe generatie Hybrid Crossfire. Ook zal Leo beschikken over uitgebreidere overklokfunctionaliteit en over ondersteuning voor sata 6Gbps en usb 3.0.

/i/1253627114.png?f=fpa)

/i/1249462591.png?f=fpa)

/i/1241443636.png?f=fpa)

/i/1252402642.png?f=fpa)

/i/1240472687.png?f=fpa)

/i/1240489321.png?f=fpa)

/i/1240424596.png?f=fpa)

/i/1113917442.png?f=fpa)

:strip_exif()/i/1181810633.jpg?f=fpa)