zoals ik al zei tearing, maar ook onregelmatige frametimes. De regel die veel mensen in hun hoofd hebben dat hoe meer fps beter is dat klopt niet. Je kan beter stabiele frametimes hebben voor een soepele ervaring.

Ik heb dus liever 80 fps met stabiele frametimes, dan 150 fps met onstabiele frametimes.

Zijn veel artikelen over en testen die het op Youtube beter uitleggen, mocht je er meer van willen weten:

https://www.youtube.com/watch?v=4yeROJQR_qE

https://medium.com/@laksh...mooth-gaming-fbd740410e04

Er zit namelijk nog best een kunst in om de sweetspot van een loodrechte frametime te behalen.

Maar als je dat eenmaal hebt, en je speelt dat een uur dan weet je dat je niet meer anders wilt, het is in combinatie met G-Sync echt een groot verschil (Het is een gevoelsmatig iets ook, maar wel zeker meetbaar met Rivatuner)

In de praktijk ligt het allemaal wat genuanceerder.

Eerste punt om in gedachte te houden is dat hele hoge fps wel degelijk altijd een latency voordeel oplevert, ook op een 60 hz monitor. Voor wie praktisch is ingesteld:

Linustechtips heeft recent met een (ex) pro gamer getest

- 60FPS/60Hz

- 300FPS/60Hz

- 240FPS/240 HZ

De resultaten:

0.67 hits op 60 FPS,

6 hits op 300 FPS en

7.66 hits op 240 Hz.

Hier zie je dus dat met 300 FPS op 60 Hz véél beter resultaten worden behaald dan met 60 FPS op 60 Hz.

De verklaring hiervoor is vrij simpel. Wanneer er iets op je scherm gebeurd dan reageer jij daar als mens op, bijvoorbeeld door op een knop te drukken. Dat is de eerste set vertraging (zien, denken, bewegen, clicken, enz). Vervolgens wordt dit signaal omgezet en opgepakt door de game en

in de volgende frame verwerkt. In die volgende frame zit het probleem. Want bij 60 Hz duurt een frame 1/60 = 16 Ms. Met een beetje pech kom je ongunstig uit (of heb je een frame buffer) en zit je op 2x 16 = 32 ms latency. Daar komt dan vervolgens ook nog de latency van het scherm zelf bij. Hierdoor ervaar je een enorme stroperigheid en moet je eigenlijk 'vooruit' gaan denken in je interactie met de game. Als je veel gamed kun je dit leren, maar prettig is anders. Ga je naar 300 fps (extreem voorbeeld) dan praten we over 3ms per frame en daarmee ben je van een enorme latency bottleneck verlost, ook op die 60 Hz monitor.

Heb je daarom persé 300 fps nodig? Nee want zodra je een hogere Hz monitor pakt dan pak je enorm veel terug aan de andere kant. Persoonlijk, dus 100% subjectief, merk ik geen verschil tussen 120 Hz en 144 Hz. Echter in rainbow six siege speel ik alsnog liever met 180 fps dan met 120 fps op die 120Hz monitor. Zo lang het totale plaatje van latency maar klopt is er niets aan de hand. Maar het is zeker niet dat hoge fps niets toevoegt, want dat doet het aantoonbaar wel.

Dan over de stabiliteit: Tja er zit een kern van waarheid in. Maar ook hier ligt het allemaal wat genuanceerder. Wat je wil voorkomen is microstutter, het ervaren van een korte hapering die je niet terug ziet in je normale FPS weergave. Microstutter kun je tegenwoordig vastleggen met vrijwel elke tool (rivatuner/msi afterburner/fraps) in de vorm van de frame time 1% low en 0.1% low. Stel je haalt 150 FPS en ineens zak je heel kort in naar 29 FPS dan zie je dit niet in je normale FPS meter maar jij ervaart wel dat je game voor je gevoel even niet reageert.

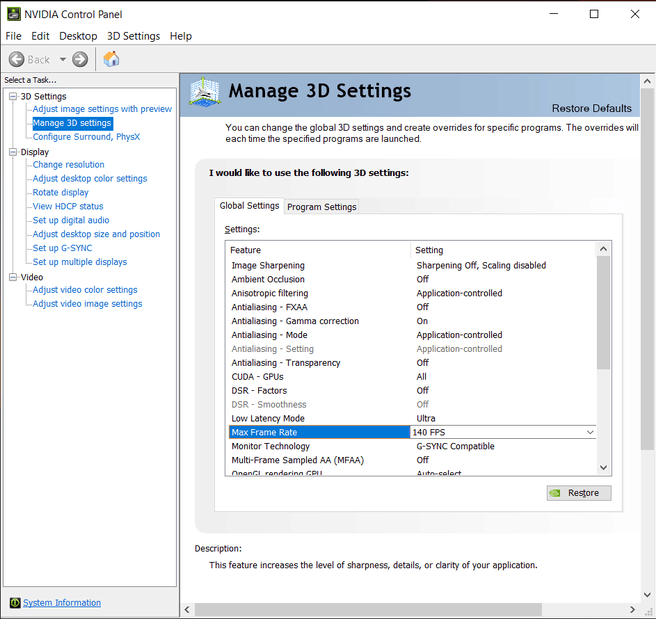

Ik heb dit letterlijk meegemaakt op mijn 2500K icm rainbow six siege dat ik enorm veel dips had naar <30 fps terwijl mijn frame rate boven de 100 zat. In dat scenario is het inderdaad beter om een lagere frame rate aan te houden. Immers dan krijgt de cpu wat lucht en krijg je minder extreme frame drops. Dit is exact wat ik destijds heb gedaan. Zie screenshot:

https://tweakers.net/ext/...7Cc/full.png?nohitcount=1

Samevatting:

- 2500K uncapped: 103 FPS met dip naar 29 fps

- 2500K 80 fps limit: 79 fps met dip naar 40 fps

- 8700K uncapped: 140 fps met dip naar 86 fps

- 8700K 120 fps limit: 120 fps met dip naar 98 fps

We zien daar duidelijk dat ik mijn 0.1% low frame rates onderhand verdubbel door een frame rate limiter te gebruiken. Dus in die situatie moet ik je 100% gelijk geven.

Nu de nuance: met dezelfde settings dip ik uncapped naar 86 FPS. Het cappen van die frame rate voegt niets meer toe omdat je deze microdips niet opmerkt en het effect ook minder groot is (13% verbetering ipv 137%). Anno 2019 heb ik een andere videokaart, draait de cpu met een overclock en heb ik lagere details en haal ik gemiddeld 180 FPS. Nu het stuk dat ik niet met je eens bent: Die 180 fps hoeft absoluut niet loodrecht te zijn voor een soepele game ervaring. Dat dit zichtbaar schommelt tussen de 130 en 180 heb ik helemaal geen last van. Dus ik kan je in mijn huidige situatie geen gelijk geven. Ik heb liever die 'instabiele' 180 fps dan dat ik op 90 fps zou gaan cappen.

In de praktijk:

1) zo lang 0.1%/ 1% dips niet onder de 80 fps vallen heb je daar helemaal geen last van

2) zo lang je gpu de bottleneck is en niet je cpu dan heb je zelden last van dips

[Reactie gewijzigd door sdk1985 op 23 juli 2024 03:43]

/i/2000820476.png?f=fpa)

:strip_exif()/i/2003273254.jpeg?f=fpa)

/i/1239798739.png?f=fpa)

/i/2001507511.png?f=fpa)

/i/2001698321.png?f=fpa)

:strip_exif()/i/2002463806.jpeg?f=fpa)