Het uitkomen van de GeForce 8800-kaarten heeft niet tot 'significant hogere' verkoopcijfers geleid, zeggen nVidia's Taiwanese partners. Volgens hen wachten de klanten, ondanks de uitstekende prestaties van de G80-core, op goedkopere varianten.

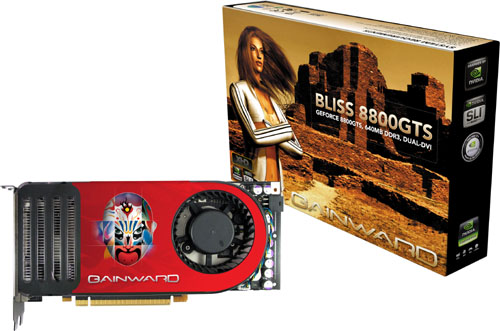

De G80 is onbetwist de snelste verkrijgbare gpu van dit moment en beschikt bovendien over volledige DirectX 10-ondersteuning. Met name de 8800 GTS wordt door recensenten, ondanks een prijs van zowat 450 euro, als 'een koopje' betiteld, maar al het goede nieuws bleek niet genoeg om de veeleisende consument in groten getale naar de winkel te laten hollen. Mogelijk houdt dat verband met de opvolgers, schrijft DigiTimes: de recentste roadmaps van nVidia vermelden de G84 en de G86, die de G80-architectuur voor respectievelijk instapmodelletjes en middenklassers beschikbaar moeten maken.

De nieuwe gpu's van nVidia moeten in het eerste kwartaal van 2007 op de markt verschijnen; samples van de nieuwe chips zouden in januari of februari bij de fabrikanten arriveren. Concurrent ATi zou in hetzelfde kwartaal met de R600-gpu komen, die eveneens DirectX 10-compatible is. Overigens wordt al enige tijd rekening gehouden met een zwakke grafischekaartenmarkt: consumenten zouden niet zozeer zitten te wachten op goedkope DirectX 10-kaarten, maar willen vooral weten welke hardware het best met Microsofts Vista overweg kan. Omdat de consumenteneditie van dit besturingssysteem eind januari verschijnt, lijkt het er hoe dan ook op dat er vanaf februari spannende tijden voor de gpu-bakkers aanbreken.

:fill(white):strip_exif()/i/2000783144.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000783984.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000784589.jpeg?f=thumbmedium)

:strip_exif()/i/1164027128.jpg?f=thumbmedium)

:fill(white):strip_exif()/i/2000783199.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000783141.jpeg?f=thumbmedium)

:strip_exif()/i/1163019500.jpg?f=thumbmedium)

:strip_exif()/i/1163019499.jpg?f=thumbmedium)

:fill(white):strip_exif()/i/2000783210.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/2000783182.jpeg?f=thumbmedium)

/i/1167403792.png?f=fpa)