Nadat vorige maand de eerste ervaringen met de Apple 17" iMac Core Duo op het web verschenen, heeft nu ook AnandTech een exemplaar onder de loep genomen en de iMac Core Duo vergeleken met een iMac G5. Daarin wordt eerst nog even teruggeblikt op Apples aankondiging van de overstap naar het Intel-platform en de daarmee gepaard gaande problemen en vertragingen. Na deze overpeinzingen begint de reviewer met het voorstellen en beoordelen van de nieuwe iMac.

Het low-end model is uitgerust met een 17"-breedbeeldscherm met een resolutie van 1440x900 pixels. Een 20"-scherm op 1680x1050 behoort echter ook tot de mogelijkheden. De aansturing van dit scherm gebeurt door een ATi X600 bij de iMac G5 en door een Radeon X1600 bij de met een Intel-chip uitgeruste iMacs. Beide configuraties zijn uitgerust met 512MB werkgeheugen, maar daarbij maakt de reviewer meteen de opmerking dat dit ook wel het absolute minimum is voor OS X. Een geheugenupgrade, een van de enige aanpassingen die mogelijk zijn aan deze systemen, is dan ook een van de eerste zaken om te overwegen en kan eenvoudig uitgevoerd worden. Een leuke gadget die deze Intel-iMacs overgenomen hebben van de G5 is overigens de iSight-camera met een resolutie van 640x480 pixels en de microfoon die bovenaan in het scherm geïntegreerd zijn.

Het low-end model is uitgerust met een 17"-breedbeeldscherm met een resolutie van 1440x900 pixels. Een 20"-scherm op 1680x1050 behoort echter ook tot de mogelijkheden. De aansturing van dit scherm gebeurt door een ATi X600 bij de iMac G5 en door een Radeon X1600 bij de met een Intel-chip uitgeruste iMacs. Beide configuraties zijn uitgerust met 512MB werkgeheugen, maar daarbij maakt de reviewer meteen de opmerking dat dit ook wel het absolute minimum is voor OS X. Een geheugenupgrade, een van de enige aanpassingen die mogelijk zijn aan deze systemen, is dan ook een van de eerste zaken om te overwegen en kan eenvoudig uitgevoerd worden. Een leuke gadget die deze Intel-iMacs overgenomen hebben van de G5 is overigens de iSight-camera met een resolutie van 640x480 pixels en de microfoon die bovenaan in het scherm geïntegreerd zijn.

Ook op softwaregebied zijn er wijzigingen vast te stellen. Met Front Row klopt Apple namelijk aan bij gebruikers die hun computer vooral als mediacenter willen gebruiken. Front Row kan dan ook bestuurd worden met de afstandsbediening en biedt eenvoudige toegang tot foto's, muziek, video's en dvd's. De reviewer stelt dat het programma nog mijlen verwijderd is van Windows Media Center Edition, maar vraagt zich ook af of Apple wel een dergelijk systeem wilde creëren. Het lijkt er meer op dat het bedrijf gewoon het concept van een dergelijke media-interface wilde introduceren aan zijn gebruikers. De software werkt overigens wel uitstekend, aldus de reviewer, en de integratie van de Quicktime-filmtrailers in het pakket is een leuke extra. Het enige minpunt is dat de interface soms een beetje traag reageert en de 'snappiness' van Windows Media Center Edition mist.

| iMac Core Duo 1,83 GHz | |||

| iMac G5 1,9 GHz | |||

| iMac Core Solo 1,83 GHz | |||

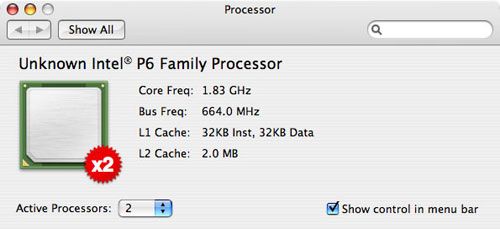

Bij het uittesten van beide versies, stelde de reviewer overigens vast dat de Intel-editie dan wel fluisterstil is, maar wel meer geheugen lijkt te verbruiken. Met een gemiddeld verschil van 1 tot 2 MB per applicatie, betekent dat de Intel-machine meteen na het opstartproces al 15MB meer geheugen verbruikt dan de PowerPC-versie. Tussen beide iMacs is bij normaal gebruik overigens verder geen verschil te merken, enkel wanneer men specifieke dialoogvensters gaat opzoeken komt men te weten of het een Intel- of PowerPC-iMac betreft. Gezien de compleet andere architectuur is dit volgens de reviewer toch een knappe prestatie. Wat de reviewer wel opviel, was het feit dat de omschakeling van een single-core naar een dual-core chip onder Mac OS X veel minder duidelijk prestatievoordeel oplevert dan in Windows. Daarvoor geeft hij twee mogelijke verklaringen. Ten eerste is het mogelijk dat de scheduler van OS X gewoon beter is, waardoor er minder prestatieproblemen op een single-core processor zijn. Anderzijds acht hij het ook niet ondenkbaar dat de geheugenhoeveelheid van 512MB al een bottleneck vormt, zodat er niet ten volle van de twee cores geprofiteerd wordt. Voor specifieke vergelijkingen wordt overigens een uitgebreid gamma benchmarks gedraaid.

| iMac G5 1,9 GHz | |||

| iMac Core Duo 1,83 GHz | |||

| iMac Core Solo 1,83 GHz | |||

AnandTech staat overigens uitgebreid stil bij het 'Performance per Watt'-argument dat door Steve Jobs ooit aangehaald werd als een van de redenen om over te stappen van PowerPC- naar Intel-chips. In een presentatie werd geclaimd dat met Intel tot meer dan vier keer betere prestaties haalbaar zouden worden in integerbewerkingen ten opzichte van IBM's PowerPC-chip. De reviewer besloot dan ook het energieverbruik van beide systemen aan een nader onderzoek te onderwerpen. Beide iMacs werden zo identiek mogelijk geconfigureerd, maar toch is de Core Duo-versie enigszins in het voordeel door zijn X1600-gpu op 90nm, in verhouding tot de X600 op 130nm. Doordat de gebruikte tests echter vooral cpu-intensief zijn en niet op de grafische mogelijkheden leunen, wordt het effect hiervan geminimaliseerd. Ook in het geheugen zit een afwijking: terwijl het Intel-systeem voorzien is van DDR2-667-reepjes, blijft de G5 op DDR2-533 steken. Idle zet de Core Duo meteen al een net resultaat neer, met een totaal energieverbruik dat slechts tweederde van dat van de G5 bedraagt. Ook onder belasting blijft de Intel-machine beduidend minder energie verbruiken dan de met een PowerPC-chip uitgeruste configuratie. Het uitschakelen van de tweede core, heeft overigens opvallend weinig invloed op het energieverbruik. Wanneer de prestaties per watt berekend worden, haalt de Core Duo zelfs een score die bijna dubbel zo hoog ligt als die van de G5. Met een core uitgeschakeld doet de Intel het nog steeds beter dan de IBM-chip, maar wordt het verschil veel kleiner.

| iMac Core Solo 1,83 GHz | |||

| iMac Core Duo 1,83 GHz | |||

| iMac G5 1,9 GHz | |||

Tot slot belicht de reviewer ook nog even het principe van 'universal binaries' en Rosetta. Hoewel er heel wat programma's al beschikbaar zijn om op zowel PowerPC- als Intel-Macs gedraaid te worden, ontbreken er nog steeds enkele belangrijke namen waaronder Microsoft Office, de producten van Adobe en zelfs de professionele software van Apple zelf. Voor die programma's heeft Apple Rosetta ontwikkeld, dat de PowerPC-code van niet-universele binaries automatisch vertaalt naar x86-opdrachten voor de Intel-processor. Hoewel de code gecached wordt, brengt dit nog steeds een duidelijk prestatieverlies met zich mee. Bovendien stijgt ook het geheugenverbruik drastisch wanneer Rosetta gebruikt wordt voor een applicatie.

:strip_exif()/i/1186565375.jpg?f=fpa)

:strip_exif()/i/1175289569.gif?f=fpa)