Nadat nVidia's TurboCache al uitgebreid in de praktijk onder de loep genomen was, vond Hot Hardware dat de tijd rijp was om ATi's antwoord daarop te onderzoeken. Theoretisch gezien doen beide technologieën hetzelfde: ze nemen een deel van het systeemgeheugen over en wijzen dit toe aan de videokaart, zodat deze van minder onboard geheugen voorzien moet worden. Hoewel ATi razend enthousiast is over deze technologie, zijn er nog geen kaarten beschikbaar die hiermee uitgerust zijn, zodat het voorlopig bij een vooruitblik op basis van specificaties blijft. Als eerste worden even de dingen die men wel al weet op een rijtje gezet. Zo zal er een Radeon X300-versie zijn met 128MB en met 256MB HyperMemory-geheugen. Beide kaarten zullen de RV370-core gebruiken op 325MHz en zullen het lokale geheugen op 300MHz geklokt hebben.

Dankzij de 64bit-geheugenbus zullen deze kaarten in totaal tegen 4,8GB/s met het lokale geheugen kunnen communiceren en met 12,8GB/s in combinatie met met het systeemgeheugen. Het gaat hierbij vanzelfsprekend over communicatie over een PCI Express-bus, aangezien AGP-varianten van deze kaarten niet ontwikkeld zullen worden. Volgens Hot Hardware is het aanbod bij ATi veel gebalanceerder. Zo hebben beide kaarten een 64bit-geheugenbus en consistente kloksnelheden, in tegenstelling tot de TurboCache-kaarten met zowel een 32bit- als een 64bit-geheugenbus en de uiteenlopende frequenties, waardoor de nVidia-kaarten allemaal een andere theoretische maximum bandbreedte hebben. Bovendien heeft ATi genoeg aan 256MB systeemgeheugen, terwijl de GeForce 6200 TC minimaal 512MB vereist.

Dankzij de 64bit-geheugenbus zullen deze kaarten in totaal tegen 4,8GB/s met het lokale geheugen kunnen communiceren en met 12,8GB/s in combinatie met met het systeemgeheugen. Het gaat hierbij vanzelfsprekend over communicatie over een PCI Express-bus, aangezien AGP-varianten van deze kaarten niet ontwikkeld zullen worden. Volgens Hot Hardware is het aanbod bij ATi veel gebalanceerder. Zo hebben beide kaarten een 64bit-geheugenbus en consistente kloksnelheden, in tegenstelling tot de TurboCache-kaarten met zowel een 32bit- als een 64bit-geheugenbus en de uiteenlopende frequenties, waardoor de nVidia-kaarten allemaal een andere theoretische maximum bandbreedte hebben. Bovendien heeft ATi genoeg aan 256MB systeemgeheugen, terwijl de GeForce 6200 TC minimaal 512MB vereist.

| Kaart | Core / Geheugen (MHz) | Onboard geheugen (MB) | Totaal geheugen (MB) | Lokale bandbreedte (GB/s) | Totale bandbreedte (GB/s) |

| Radeon X300 SE 128 | 325 / 300 | 32 | 128 | 4,8 | 12,8 |

| Radeon X300 SE 256 | 325 / 300 | 128 | 256 | 4,8 | 12,8 |

| GeForce 6200 16-TC 128MB | 350 / 350 | 16 | 128 | 2,8 | 10,8 |

| GeForce 6200 32-TC 128MB | 350 / 350 | 32 | 128 | 5,6 | 13,6 |

| GeForce 6200 64-TC 256MB | 350 / 275 | 64 | 256 | 4,4 | 12,4 |

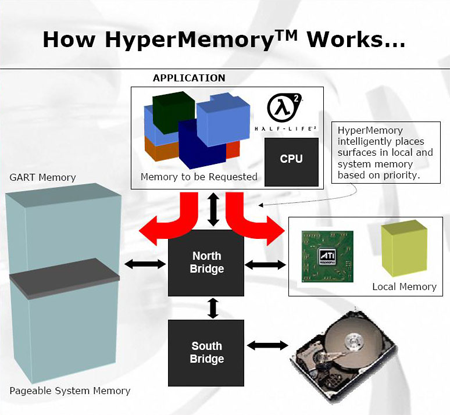

Alvorens men zich aan een voorspelling van de prestaties waagt, gaat Hot Hardware eerst wat dieper in op de werking van HyperMemory. In tegenstelling tot traditionele videokaarten, waarbij alle communicatie met het systeemgeheugen via de Northbridge moet passeren, hebben HyperMemory-kaarten wel rechtstreeks toegang tot dit geheugen. Geïntegreerde videochips op het moederbord doen dit ook, maar het verschil is dat HyperMemory in staat is het gereserveerde geheugen dynamisch uit te breiden of in te krimpen. Daar worden drie componenten voor gebruikt: de HyperMemory-software, de HyperMemory-geheugencontroller en de PCI Express-verbinding. Wanneer een geheugenblok aangesproken wordt, bepaalt de software automatisch of het hierbij om systeemgeheugen of lokaal geheugen gaat en kan deze desgewenst data verplaatsen om resources vrij te geven en veelgebruikte data toch naar het lokale geheugen te halen. Indien nodig kan de HyperMemory-software data ook van het systeemgeheugen naar de pagefile wegschrijven.

Tot slot baseert Hot Hardware zich op enkele ATi-grafieken en -specificaties om een poging te doen te voorspellen hoe de prestaties van HyperMemory zich zullen verhouden tot deze van de TurboCache-technologie. In deze tests werd volgens ATi steeds gebruikgemaakt van de minimale systeemeisen, wat zou betekenen dat het ATi-systeem uitgerust werd met 256MB en de nVidia-kaarten 512MB systeemgeheugen meekregen. Er wordt echter niet gemeld of het om een TC-16- of TC-32-variant gaat, zodat het onduidelijk is of het nVidia-systeem over een 32bits- of een 64bits-geheugenbus kon beschikken. In de tests zien we, gezien de bron van de grafieken niet geheel onverwacht, dat de Radeon X300 beduidend sneller is dan de GeForce en de i915G-chipset. Enkel in Doom3 illustreet ATi zelf dat nVidia nipt sneller is, maar zowel in FarCry, Half-Life 2, 3DMark01 als in PCMark heeft de Radeon een duidelijke voorsprong.

Hot Hardware concludeert dan ook dat ATi's HyperMemory-technologie zeker een kanshebber is, maar dat het wel belangrijk is dat kaarten op basis van deze technologie snel beschikbaar worden. Het bedrijf wil en kan hiermee relatief goedkope hardware ontwikkelen om toch tot vijfentwintig procent betere prestaties te bieden. In tegenstelling tot de TurboCache-kaarten zal het voor de gebruikers vermoedelijk gemakkelijker zijn een keuze te maken, aangezien elke Radeon HyperMemory-kaart over dezelfde bandbreedte zal beschikken. Vermoedelijk zal de 128MB-versie 59 dollar gaan kosten, beduidend lager dan de introductieprijs van de GeForce Turbocache.