Het Quantum Volume van qubit-systemen moet jaarlijks op zijn minst verdubbelen om in de komende tien jaar klassieke computing te verslaan met een werkende quantumcomputer, stelt IBM.

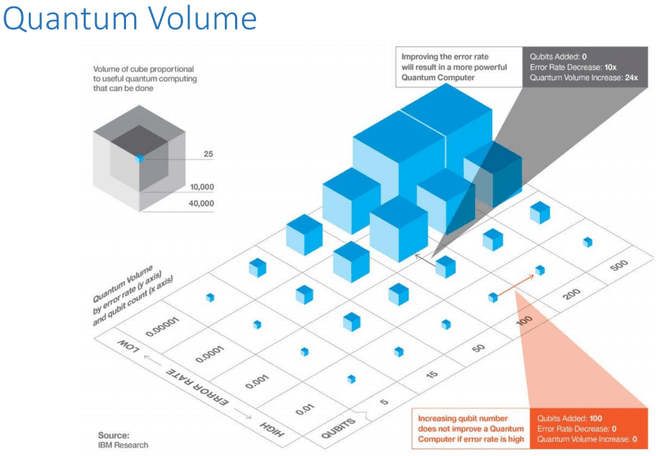

IBM gebruikt Quantum Volume als indicatie van de prestaties van een quantumcomputer, als alternatief voor simpelweg het aantal qubits van een systeem. Het gaat om een meting aan het grootste quantumcircuit met dezelfde breedte en diepte van quantumsystemen, waarbij de uitkomst iets zegt over de foutmarge. Hoe meer ongecontroleerde interacties binnen het systeem plaatsvinden, hoe lager het Quantum Volume en omgekeerd.

De meetmethode is door IBM toegepast op zijn verschillende quantumprocessors. Zo heeft het systeem met codenaam Tenerife uit 2017 met vijf qubits een Quantum Volume van vier, de Tokyo uit 2018 met twintig qubits een volume van acht en de IBM Q Systemen One van dit jaar, met eveneens twintig qubits, een Quantum Volume van zestien.

De methode is bedoeld voor zogenoemde nisq-systemen, wat staat voor noisy intermediate-scale quantum. Dit zijn quantumsystemen van nu en de nabije toekomst, die nog niet voor een revolutie wat betreft rekenwerk gaan zorgen, maar wel het tijdperk in gaan luiden waarin quantumcomputers krachtiger worden dan de snelste klassieke computers.

Om dit moment van quantum advantage, ook wel quantum supremacy genoemd, in de komende tien jaar te bereiken, moet de jaarlijkse verdubbeling van het quantum volume zich doorzetten, betoogt IBM, die daarbij de vergelijking maakt met de beroemde Wet van Moore. Volgens IBM is sprake van een significante prestatieverbetering ten opzichte van klassieke computing als een berekening honderden of duizenden keer sneller verloopt, een fractie van de hoeveelheid werkgeheugen vereist of een resultaat oplevert dat nooit via een klassieke computer behaald had kunnen worden.

IBM heeft ook benchmarks op qubit-niveau gedraaid, onder andere om de foutmarge van een enkele qubit en die van een controlled not-gate van twee qubits vast te stellen. Ook hieruit bleek dat de eigenschappen van de IBM Q System One flink verbeterd zijn ten opzichte van de eerste generatie systemen. IBM maakt in de tweede helft van 2019 nieuwe quantumsystemen met hogere prestaties beschikbaar, bij de opening van zijn nieuwe quantumcomputingcentrum in de staat New York.

/i/2002543006.jpeg?f=imagenormal)

:strip_icc():strip_exif()/i/2001777363.jpeg?f=fpa_thumb)

/i/2001777375.png?f=fpa)

/i/2003431888.png?f=fpa)

:strip_exif()/i/1286274802.jpeg?f=fpa)

/i/1240844012.png?f=fpa)