Ome Tom was wel eens benieuwd naar de zin en onzin van de grafische krachtpatsers die in veel moderne computersystemen te vinden zijn en besloot te onderzoeken welke videokaart een gebruiker nu eigenlijk echt nodig heeft. Niet alleen kijkt men of een krachtige videokaart wel nodig is, maar men vraagt zich ook af of het ontbreken daarvan in een entry-level pc het nut van dit systeem onderuit haalt. Een dergelijk systeem wordt namelijk niet gebruikt voor veeleisende games en voor het weergeven van video's en dvd's volstaat de eenvoudigste beschikbare videokaart. Het wordt een ander verhaal wanneer men HDTV bekijkt, omdat er dan aanzienlijk meer data verwerkt moet worden. De enige echte reden voor al het grafische geweld waar we tegenwoordig mee om de oren geslagen worden is terug te vinden in games die steeds realistischer en veeleisender worden.

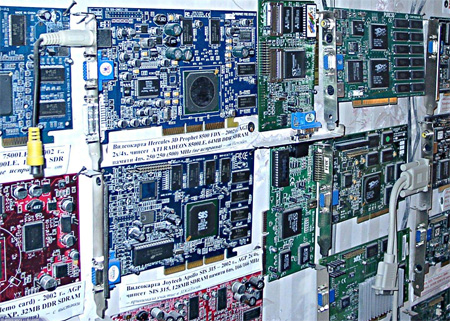

Aangezien de eisen die aan de grafische kaart gesteld worden afhankelijk zijn van de taken die men ermee wil gaan uitvoeren, wordt een onderscheid gemaakt tussen de 'Internet & Office'-gebruiker, de mainstream gamers, de die-hardgamer, de multimediagebruiker en de gebruiker van professionele applicaties. Voor de kantoorgebruiker is de reviewer duidelijk: aangezien deze systemen nooit met games in aanraking komen volstaat hier eigenlijk zelfs een onboard geïntegreerde oplossing. Wie toch een extra videokaart wil installeren kan terecht bij de Radeon X300, Radeon 9200, Volari V3 of GeForce 4 MX. De gewone gamers kunnen het beter bij de Radeon X600, X700, 9550 en 9600 zoeken. In de nVidia-stal kunnen zij terecht bij de GeForce 6200 en 6600. Alternatieven zijn er in de vorm van S3's DeltaChrome S8 en XGI's Volari V5.

Aangezien de eisen die aan de grafische kaart gesteld worden afhankelijk zijn van de taken die men ermee wil gaan uitvoeren, wordt een onderscheid gemaakt tussen de 'Internet & Office'-gebruiker, de mainstream gamers, de die-hardgamer, de multimediagebruiker en de gebruiker van professionele applicaties. Voor de kantoorgebruiker is de reviewer duidelijk: aangezien deze systemen nooit met games in aanraking komen volstaat hier eigenlijk zelfs een onboard geïntegreerde oplossing. Wie toch een extra videokaart wil installeren kan terecht bij de Radeon X300, Radeon 9200, Volari V3 of GeForce 4 MX. De gewone gamers kunnen het beter bij de Radeon X600, X700, 9550 en 9600 zoeken. In de nVidia-stal kunnen zij terecht bij de GeForce 6200 en 6600. Alternatieven zijn er in de vorm van S3's DeltaChrome S8 en XGI's Volari V5.

Die-hardgamers eisen echter het maximale van hun hardware en kunnen het dan ook beter in de hogere regionen gaan zoeken. Zij zullen niet teleurgesteld worden door de Radeon X800 of X850 en de GeForce 6800. In de multimediasector is het namelijk vooral ATi die domineert met zijn 'All in Wonder'-reeks. De Personal Cinema-kaarten van nVidia zijn vergelijkbaar, maar bevatten veel minder recente modellen. Matrox biedt dan weer oplossingen voor het meer professionele capture-werk. Ook voor CAD-tekenaars en andere professionele gebruikers zijn er alternatieven, waaronder 3D Labs' Wildcat en Matrox' Parhelia. ATi en nVidia worden hier respectievelijk vertegenwoordigd door de FireGL- en Quadro-lijn.

Die-hardgamers eisen echter het maximale van hun hardware en kunnen het dan ook beter in de hogere regionen gaan zoeken. Zij zullen niet teleurgesteld worden door de Radeon X800 of X850 en de GeForce 6800. In de multimediasector is het namelijk vooral ATi die domineert met zijn 'All in Wonder'-reeks. De Personal Cinema-kaarten van nVidia zijn vergelijkbaar, maar bevatten veel minder recente modellen. Matrox biedt dan weer oplossingen voor het meer professionele capture-werk. Ook voor CAD-tekenaars en andere professionele gebruikers zijn er alternatieven, waaronder 3D Labs' Wildcat en Matrox' Parhelia. ATi en nVidia worden hier respectievelijk vertegenwoordigd door de FireGL- en Quadro-lijn.

In zijn conclusie stelt de reviewer dat het vooral ATi's en nVidia's ambities om steeds snellere kaarten met betere prestaties te produceren zijn die de prijzen van de videokaarten de hoogte in gejaagd hebben. Voor het grootste deel van de gebruikers is al deze grafische kracht echter overbodig en deze fabrikanten zullen zich volgens Toms Hardware dan ook moeten herpakken als ze een echte rol willen blijven spelen op de entry-levelmarkt. De geïntegreerde oplossingen in chipsets en onboard chips vormen namelijk een belangrijke concurrent voor de low-endvideokaarten. Met de nForce-chipset heeft nVidia op deze markt een belangrijk voordeel, hoewel de Xpress 200 van ATi een sterk alternatief is. De recente goedkope kaarten, de X300 HyperMemory en de GeForce 6200 TC, zijn vanwege hun prijs echter niet interessant voor kantoorgebruik en vanwege de prestaties niet interessant voor gamers, aldus de reviewer.

In zijn conclusie stelt de reviewer dat het vooral ATi's en nVidia's ambities om steeds snellere kaarten met betere prestaties te produceren zijn die de prijzen van de videokaarten de hoogte in gejaagd hebben. Voor het grootste deel van de gebruikers is al deze grafische kracht echter overbodig en deze fabrikanten zullen zich volgens Toms Hardware dan ook moeten herpakken als ze een echte rol willen blijven spelen op de entry-levelmarkt. De geïntegreerde oplossingen in chipsets en onboard chips vormen namelijk een belangrijke concurrent voor de low-endvideokaarten. Met de nForce-chipset heeft nVidia op deze markt een belangrijk voordeel, hoewel de Xpress 200 van ATi een sterk alternatief is. De recente goedkope kaarten, de X300 HyperMemory en de GeForce 6200 TC, zijn vanwege hun prijs echter niet interessant voor kantoorgebruik en vanwege de prestaties niet interessant voor gamers, aldus de reviewer.

:strip_exif()/i/1101926231.jpg?f=fpa)