Microsoft geeft testers de mogelijkheid om Windows Server te booten vanaf het bestandssysteem ReFS. Dat alternatief voor Windows' standaard NTFS is al jaren in ontwikkeling. Het biedt betere bescherming tegen datacorruptie en kan schalen tot opslagvolumes van 35PB.

Het Resilient File System van Microsoft maakte zijn debuut met de komst van Windows Server 2012, maar was niet te gebruiken voor het bootvolume van Windows. Dat moest nog altijd geformatteerd zijn met NTFS. Daarin komt nu verandering. Testers in het Windows Insider-programma van Microsoft kunnen de Insider Preview van Windows Server installeren en dan laten draaien op ReFS-volumes.

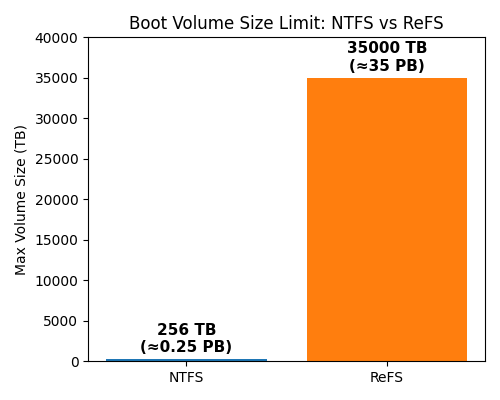

Het alternatieve bestandssysteem van Microsoft biedt betere bescherming tegen zogeheten bitrot. Daarbij kan opgeslagen data corrupt raken door verlies van bijvoorbeeld magnetische of elektrische lading van het opslagmedium. Daarnaast brengt ReFS verbeteringen voor het prestatieniveau van opslag en ondersteunt het volumes tot een maximale capaciteit van 35PB. NTFS kan maximaal 256TB aan.

Builds van de testrelease van Windows Server bieden sinds 11 februari de mogelijkheid van ReFS-boot in het installatiemenu. Voor gebruik van ReFS is wel een systeem met UEFI-firmware nodig, merkt Microsoft op. Oudere virtuele machines gebruiken nog een legacybios en kunnen dit alternatieve bestandssysteem dus niet gebruiken voor hun bootvolume.

:strip_icc():strip_exif()/i/2007711926.jpeg?f=fpa_thumb)

:strip_exif()/i/2004675122.jpeg?f=fpa)

:strip_exif()/i/2005569146.jpeg?f=fpa)

/i/2004763582.png?f=fpa)

/i/2000776373.png?f=fpa)

:strip_exif()/i/1315899998.gif?f=fpa)