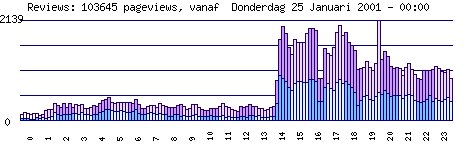

Al jaren veroorzaakt Slashdot.org een ongewenst effect op internet. Het weblog is zo populair dat iedere site die erop gelinkt wordt direct een vloedgolf van bezoekers over zich heen krijgt, wat met name bij kleinere sites zeer regelmatig het gevolg heeft dat ze volledig onbereikbaar worden. Dit zogenaamde Slashdot-effect veroorzaakt irritatie bij zowel hun eigen bezoekers als de beheerders van de getroffen sites. Het nieuwe project Mirrordot biedt een oplossing, door in alle nieuwe berichten te scannen naar links en vervolgens mirrors te bouwen van de pagina's waar naar verwezen wordt. Mirrordot is begonnen als een testproject, maar toen het ook echt bleek te werken heeft men besloten om het beschikbaar te maken voor het publiek. Niet iedereen is overigens even positief over het initiatief. Hoewel men het er wel over eens is dat er iets gedaan moet worden om kleine sites te beschermen tegen het Slashdot-effect, kunnen de grotere sites juist inkomsten mislopen door de mirrors. Ook wordt opgemerkt dat een dergelijk initiatief niet van derden maar van Slashdot zelf zou moeten komen.