Inleiding

AMD’s snelste videokaart is op dit moment de HD 4870X2. Hoewel AMD eerder had gesteld niet van plan te zijn een HD 4890X2 uit te brengen, een dubbele versie van de nieuwe HD 4890, is de halfgeleideronderneming daar nu op teruggekomen: AMD zou met een aantal partners gaan samenwerken om toch een HD 4890X2 op de markt te brengen. De specificaties van deze kaart staan nog niet vast, mede vanwege problemen met het verbruik, waar AMD overigens wel reeds een oplossing voor zou hebben gevonden.

Tweakers.net heeft dus nog geen HD4890X2 in bezit, maar we kunnen wel alvast een HD 4890X2 simuleren door twee HD 4890-kaarten in CrossFire op te stellen. De HD 4890X2 zou AMD’s snelste videokaart worden; daarom bekijken we in deze review ook de snelste kaart van Nvidia, de GTX295. Omdat bij deze kaarten de prestaties voorop staan, zijn zowel de HD4890’s in Crossfire als de GTX295 overgeklokt, om nog meer fps uit de kaarten te persen.

Het vermoeden bestond dat de cpu van het testsysteem, de standaard op 3,2Ghz overgeklokte Intel Core i7 920, mogelijk een beperkende factor was bij het grafische geweld van de twee HD 4890’s en de GTX295. Of dat inderdaad zo is, is getest door het verhogen van de kloksnelheid van de cpu: de benchmarks met de overgeklokte gpu’s zijn tweemaal gedraaid, eerst met de cpu op 3,2GHz en vervolgens op 3,6GHz.

Specificaties

De HD 4890 kwam eerder al uitgebreid aan bod. Omdat de HD 4870 het tegen de HD 4890 moet afleggen, zouden twee HD 4890’s in CrossFire in theorie eveneens sneller moeten zijn dan de HD 4870X2, een videokaart met twee RV770-gpu’s aan boord. De prestaties van twee HD 4870’s in CrossFire liggen over het algemeen zeer dicht bij die van een HD 4870X2. Ervan uitgaande dat dit ook voor de HD 4890 geldt, zou een test van twee gecombineerde HD 4890’s een goede indicatie van de prestaties van de HD 4890X2 moeten geven.

De GTX295 van Nvidia maakt gebruik van een opbouw die vergelijkbaar is met die van de HD 4870X2: op één videokaart worden twee gpu’s ingezet die met elkaar samenwerken, in het geval van Nvidia door middel van sli. Op dit moment is de GTX295 de snelste videokaart op de markt, maar met de komst van de HD 4890X2 zou daar weleens verandering in kunnen komen. Opvallend is dat de GTX295 dezelfde gpu’s aan boord heeft als de GTX275; feitelijk kan de GTX295 gezien worden als twee GTX275’s die in sli zijn opgesteld. Wel heeft de GTX275 hogere kloksnelheden dan de GTX295.

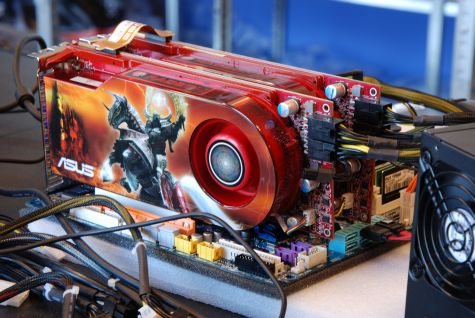

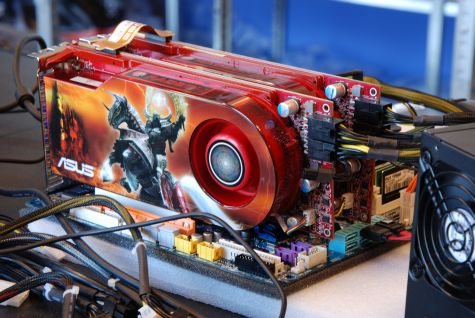

| Asus Radeon HD4890 |

| Merk |

Asus |

| Type |

EAH4890/HTDI/1GD5 |

| Technische specificaties | |

| Videochip |

RV790 XT |

| Videochipklok |

850MHz |

Aantal streamprocessors

|

800 |

| Geheugengrootte |

1GB |

| Geheugentype |

gddr5 |

| Geheugenklok |

975MHz |

| Productieprocedé |

55nm |

| Interfaces | |

| Card-interface |

pci-e 2.0 16x |

| Verbinding (video uit) |

2x dvi, hdmi |

| Koeling |

actieve koeling |

MSI Geforce GTX295

|

| Merk |

MSI |

| Type |

N295GTX-M201792 |

| Technische specificaties | |

| Videochip |

GT200b |

| Videochipklok |

655MHz |

| Aantal shaders |

2x 240

|

| Shaderklok |

1404MHz |

| Geheugengrootte |

2x 796MB |

| Geheugentype |

gddr3 |

| Geheugenklok |

1050MHz |

| Productieprocedé |

55nm |

| Interfaces | |

| Card-interface |

pci-e 2.0 16x |

| Verbinding (video uit) |

2x dvi, 1x hdmi |

| Koeling |

actieve koeling |

Testopstelling

De redactie van Tweakers.net heeft de opzet van videokaartreviews enigszins op de schop genomen. Voortaan zullen de kaarten steeds met het onderstaande Core i7-systeem getest worden. Bovendien wordt dan telkens dezelfde reeks games gebruikt, zodat de resultaten van de reviews gemakkelijker onderling vergelijkbaar worden. Wel zal de lijst met spellen indien nodig aangepast of uitgebreid worden.

Het testsysteem is opgetrokken rond een Core i7 920-processor, die op 3,2GHz is geklokt met een verhoging van de bclk tot 160MHz. De keuze voor het besturingssysteem viel op de 64bit-versie van Windows Vista Ultimate met Service Pack 1 en alle beschikbare patches geïnstalleerd. De ATI-kaarten worden via versie 9.3 van de Catalyst-drivers aangestuurd. Voor de benchmarks zijn de games Call of Duty: World at War, Crysis: Warhead, Far Cry 2, Stalker: Clear Sky en World in Conflict uitgezocht. Ook van deze games zijn, voor zover beschikbaar, alle patches geïnstalleerd. Waar mogelijk is van de interne benchmarks van de games gebruikgemaakt.

| Testsysteem |

| Moederbord |

Gigabyte GA-EX58-DS4 |

| Processor |

Intel Core i7 920 @ 3,2GHz |

| Geheugen |

6GB ddr3: 3x OCZ3X1333LV6GK 8-8-8 |

| Harde schijven |

500GB Samsung Spinpoint F1 HD502IJ |

| Videokaarten |

2x Asus Radeon HD4890 1GB

MSI Geforce GTX295 1792MB

|

| Koeler |

OCZ Gladiator

|

| Voeding |

OCZ Silencer 750EPS12V |

Intels X58-platform zal naar verwachting nog geruime tijd de prestatiekroon in handen houden. Dit platform zal bij het uitvoeren van de benchmarks niet snel een bottleneck vormen. Ook biedt het platform de mogelijkheid om videokaarten zowel in sli- als in CrossFire-modus te draaien. We streven ernaar om altijd de nieuwste drivers te gebruiken, en als er bèta-drivers gebruikt zijn, wordt dat vermeld.

Elke game is getest op de resoluties 1600x1200 en 1920x1200. De instellingen verschillen per game en zullen daarom telkens vermeld worden. In principe wordt altijd anti-aliasing toegepast, tenzij dit resulteert in onspeelbaar lage framerates. Hetzelfde geldt voor sommige ingame-settings, die naar beneden zijn bijgesteld als de videokaart onvoldoende fps wist te produceren. Wel is er altijd 16xAF toegepast; bij games die dat niet ondersteunen is deze instelling afgedwongen met behulp van ATI's CCC of Nvidia's Control Panel.

Overklokken en instellingen

Met de introductie van de HD 4890 heeft AMD een aantal veranderingen op overklokgebied doorgevoerd. De meegeleverde drivers voorzien bijvoorbeeld in de mogelijkheid om de gpu over te klokken naar 1000MHz, wat een stuk hoger dan voorheen is. De geheugenklok kan zelfs naar 1200MHz worden opgekrikt. Voor het overklokken van de videokaarten is gebruikgemaakt van ATI’s CCC en de stabiliteit is met Furmark getest. Uiteindelijk is er gekozen voor een enigzins behoudende overklok van 925MHz voor de gpu en 1100MHz voor het geheugen. Het voltage is op de standaardwaarde blijven staan.

Nvidia’s GTX295 is met Rivatuner overgeklokt. Preciezer gezegd: Rivatuner is gebruikt om de GTX295 onder te klokken naar de standaardsnelheden van 576MHz, 1242MHz en 999MHz, aangezien de geteste GTX295 een overgeklokt model van MSI betrof. Vervolgens zijn de standaardsnelheden van de MSI GTX295 weer in ere hersteld. De teller van de gpu kwam op 655MHz te staan, de shaders werden weer op 1404MHz geklokt en het geheugen kreeg een minimale boost naar 1050MHz.

In CCC is verder de adaptive aliasing op de hoogste kwaliteit gezet, wordt de toepassing van AA/AF aan de applicatie overgelaten, en is mipmapping op de hoogste kwaliteit ingesteld. In Nvidia's Control Panel staat de antialiasing transparancy-modus op multisampling en is de texture quality op high quality ingesteld.

Stalker: Clear Sky

In Stalker: Clear Sky zetten de HD 4890’s op de hoge instellingen, met sun rays, zeer acceptable framerates neer; ze lijken zelfs nog iets betere gemiddelde fps dan de GTX295 neer te zetten. Het spel heeft vooral baat bij een zo hoog mogelijke gpu-snelheid: het hoger klokken van de processor maakt minder verschil. In overgeklokte toestand weet de GTX295 de achterstand te verkleinen, maar ook dan blijven de gekoppelde HD 4890’s een fractie sneller.

Een kleine test wees overigens uit dat een cpu-klok van 3,2GHz duidelijk hogere framerates oplevert dan een cpu-klok van 2,66GHz, dus een snelle cpu is bij deze game wel degelijk van nut.

| Stalker Clear Sky - 1920x1200 - High- 0xAA/16xAF |

| 2x HD4890 |

27/56 27/56 |

| 2x HD4890 OC |

30/60 30/60 |

| 2x HD4890 OC - 3,6GHz |

29/59 29/59 |

| GTX295 |

27/51 27/51 |

| GTX295 OC |

30/57 30/57 |

| GTX295 OC - 3,6GHz |

30/58 30/58 |

Frames per seconde, hoger is beter

Bij een resolutie van 1600x1200 blijft er amper nog verschil over: de gemiddelde framerates zijn bij de ATI-kaarten iets hoger, de minimale framerates zijn bij de GTX295 een tikje hoger, al gaat het daarbij slechts om één schamele frame per seconde.

| Stalker Clear Sky - 1600x1200 - High- 0xAA/16xAF |

| 2x HD4890 |

26/63 26/63 |

2x HD4890 OC

|

29/67 29/67 |

| 2x HD4890 OC - 3,6GHz |

30/69 30/69 |

GTX295

|

27/59 27/59 |

GTX295 OC

|

30/63 30/63 |

| GTX295 OC - 3,6GHz |

31/66 31/66 |

Frames per seconde, hoger is beter

CoD: World at War

De benchmarks in Call of Duty zijn lastig te interpreteren. Blijkbaar kon het spel niet goed overweg met de extra grafische rekenkracht van de overgeklokte HD 4890’s. Er is hier echter wel een duidelijke stijging van de minimale framerates te zien wanneer de cpu wordt overgeklokt.

De GTX295 komt, vooral door hogere minima neer te zetten, als duidelijke winnaar uit de bus. Het overklokken van de videokaart levert een duidelijke en consistente prestatieverbetering op, en ook het overklokken van de cpu heeft aantoonbaar voordeel.

| Call of Duty: World At War - 1920x1200 - Max - 4xAA/16xAF |

| 2x HD4890 |

58,3/85,5 58,3/85,5 |

| 2x HD4890 OC |

57,8/80 57,8/80 |

| 2x HD4890 OC - 3,6GHz |

64/86,2 64/86,2 |

| GTX295 |

66/89,1 66/89,1 |

| GTX295 OC |

69/89,3 69/89,3 |

GTX295 OC - 3,6GHz

|

74/90,5 74/90,5 |

Frames per seconde, hoger is beter

De testen bij 1600x1200 geven een vergelijkbaar resultaat: ook hier is de GTX295 sneller, al is het verschil met de HD 4890's kleiner dan bij 1920x1200.

| Call of Duty: World At War - 1600x1200 - Max - 4xAA/16xAF |

| 2x HD4890 |

66,7/87,8 66,7/87,8 |

| 2x xHD4890 OC |

65/86,7 65/86,7 |

| 2x HD4890 OC - 3,6GHz |

70,3/89,3 70,3/89,3 |

| GTX295 |

72,6/89,8 72,6/89,8 |

| GTX295 OC |

73/90,1 73/90,1 |

| GTX295 OC -3,6GHz |

76,3/90,6 76,3/90,6 |

Frames per seconde, hoger is beter

Crysis Warhead

In Crysis Warhead op 1920x1200 is het verschil tussen de standaard geklokte en de overgeklokte HD 4890’s op de hoogste resolutie amper significant wanneer de Core i7-processor standaard wordt geklokt, maar met een overgeklokte cpu blijkt het overklokken van de HD 4890's opeens wel een duidelijke prestatiewinst op te leveren. Bij een resolutie van 1600x1200 leveren de overgeklokte ATI-kaarten ook bij een niet-overgeklokte cpu betere prestaties: daar lijkt Warhead vooral van de extra grafische rekenkracht te profiteren.

De test met de GTX295 levert een ander verhaal op. De overgeklokte GTX295 toont slechts een minimale fps-stijging ten opzichte van de standaard geklokte GTX295: de minima blijven zelfs exact gelijk. Door de cpu van 3,2GHz naar 3,6GHz over te klokken stijgen de minimale framerates met twee fps.

Een duidelijke winnaar is hier niet aan te wijzen. De HD 4890’s zetten iets hogere minima neer, maar de gemiddelde framerates blijven juist weer achter bij de gemiddelde framerates die de GTX295 neer weet te zetten.

| Crysis Warhead - 1920x1200 - Enthusiast - 0xAA/16xAF |

| 2x HD4890 |

14/27 14/27 |

| 2x HD4890 OC |

14/28 14/28 |

| 2x HD4890 OC - 3,6GHz |

15/29 15/29 |

| GTX295 |

13/30 13/30 |

| GTX295 OC |

13/35 13/35 |

| GTX295 OC - 3,6GHz |

15/35 15/35 |

Frames per seconde, hoger is beter

Op de resolutie van 1600x1200 bleek zich een merkwaardig verschijnsel voor te doen. De minima schieten bij de GTX295 in de laatste test, met de processor op 3,6GHz, de lucht in. De test werd meerdere keren uitgevoerd, maar leverde steeds dezelfde resultaten op.

| Crysis Warhead - 1600x1200 - Enthusiast - 0xAA/16xAF |

| 2x HD4890 |

14/30 14/30 |

| 2x HD4890 OC |

16/32 16/32 |

| 2x HD4890 OC - 3,6GHz |

16/32 16/32 |

| GTX295 |

15/37 15/37 |

| GTX295 OC |

15/37 15/37 |

| GTX295 OC - 3,6GHz |

25/38 25/38 |

Frames per seconde, hoger is beter

Far Cry 2

De twee HD 4890’s in CrossFire presteren flink beter dan een enkele HD 4890, maar in Far Cry 2 moeten ze het tegen de GTX295 toch afleggen. Vooral wanneer de GTX295 wordt overgeklokt laat de Nvidia-kaart het duo HD 4890's zijn hielen zien.

Vreemd genoeg lijken de HD 4890’s hier slechter te presteren wanneer ze worden overgeklokt. Ook het opvoeren van de cpu-kloksnelheid verbetert de prestaties niet, terwijl de GTX295 vooral op 1600x1200 gretig van de extra cpu-rekenkracht gebruikmaakt.

| Far Cry 2 - 1920x1200 - Ultra High - 4xAA/16xAF |

| 2x HD4890 |

59,5/80 59,5/80 |

| 2x HD4890 OC |

57,8/82,9 57,8/82,9 |

| 2x HD4890 OC - 3,6GHz |

58/86,4 58/86,4 |

| GTX295 |

63,9/81,4 63,9/81,4 |

| GTX295 OC |

67,2/86,4 67,2/86,4 |

| GTX295 OC - 3,6GHz |

68,8/90 68,8/90 |

Frames per seconde, hoger is beter

Op de lagere resolutie vergroot de GTX295 zijn voorsprong nog iets verder. Zowel het overklokken van de videokaart als het nog sterker overklokken van de cpu zorgt voor hogere minima en gemiddelden.

| Far Cry 2 - 1600x1200 - Ultra High - 4xAA/16xAF |

| 2x HD4890 |

58,6/86,4 58,6/86,4 |

| 2x HD4890 OC |

58,9/88,7 58,9/88,7 |

| 2x HD4890 OC - 3,6GHz |

59,9/90,1 59,9/90,1 |

| GTX295 |

66,6/87,2 66,6/87,2 |

| GTX295 OC |

69,1/91,5 69,1/91,5 |

| GTX295 OC - 3,6GHz |

73,2/95,6 73,2/95,6 |

Frames per seconde, hoger is beter

World in Conflict

Vergeleken met een enkele HD 4890 bieden de HD 4890's in CrossFire amper een stijging van de minimale framerates, en ook het opjutten van de cpu biedt hier geen prestatievoordelen. De gemiddelde framerates zijn met twee HD 4890's echter stukken hoger, waardoor sommige delen van World in Conflict zich met het ATI-duo een stuk vloeiender laten spelen dan met slechts één HD 4890.

Aangezien de minimale framerates in sommige testruns zelfs beneden de 10fps kwamen te liggen, kan er niet heel veel waarde aan de minimale scores gehecht worden. Afgaande op de gemiddelde framerates moet de GTX295 als nipte winnaar worden aangewezen.

| World in Conflict - 1920x1200 - Maximum - 4xAA/16xAF |

| 2x HD4890 |

15/56 15/56 |

| 2x HD4890 OC |

16/55 16/55 |

| 2x xHD4890 OC - 3,6GHz |

15/58 15/58 |

| GTX295 |

16/57 16/57 |

| GTX295 OC |

16/59 16/59 |

| GTX295 OC - 3,6GHz |

17/62 17/62 |

Frames per seconde, hoger is beter

Op de resolutie van 1600x1200 lijkt het erop dat de HD 4890's iets hogere minima neerzetten. De verschillende testruns leverden hier consistentere resultaten op, zonder scores onder de tien fps. Ook hier is de gemiddelde score weer in het voordeel van de GTX295, die bovendien beter van toegenomen cpu-kracht lijkt te kunnen profiteren.

| World in Conflict - 1600x1200 - Maximum - 4xAA/16xAF |

| 2x HD4890 |

17/57 17/57 |

| 2x HD4890 OC |

18/59 18/59 |

| 2x xHD4890 OC - 3,6GHz |

17/58 17/58 |

| GTX295 |

16/60 16/60 |

| GTX295 OC |

17/63 17/63 |

| GTX295 OC - 3,6GHz |

17/66 17/66 |

Frames per seconde, hoger is beter

Energieverbruik en geluidsproductie

Geluid

Geluid

De HD 4870’s waren in hun introductiedagen niet de stilste videokaarten op de markt. De koeler deed zijn werk, maar liet op het gebied van geluidsproductie behoorlijk wat te wensen over. Met de komst van de HD 4890 is daar weinig aan veranderd. In 2d-modus is de ventilator nog wel stil, maar zodra de gpu belast wordt gaat de fan-snelheid rap omhoog, en dat is te horen.

Geluidsproductie (dBA)

|

| 2x HD4890 - idle |

45 45 |

| 2x HD4890 - load |

61,2 61,2 |

| GTX295 - idle |

48,1 48,1 |

| GTX295 - load |

59,4 59,4 |

De GTX295 is in 2d-modus hoorbaar luider dan de twee HD4890's, maar de videokaart is dan ook een stuk koeler. Wat betreft de temperatuur kan de ventilator gerust op een wat lager toerental draaien, maar dat moet dan wel handmatig ingesteld worden. De ventilator gaat pas hoorbaar harder draaien als de gpu's écht warm worden.

De HD 4890's werden eerst een tijdje met rust gelaten en behaalden toen een minimale temperatuur van 57 graden Celsius. Bij de geluidsmeting werd een waarde van 45dBA opgetekend. Door de videokaarten vervolgens met de Furmark-stresstest te belasten, werden de kaarten behoorlijk heet, met een temperatuur van 82 graden. Daarbij werd een geluidsproductie van 61,2dBA geregistreerd: een aanzienlijke verhoging.

De GTX295 is in 2d-modus slechts 47 graden warm, maar produceert dan wel 48,1dBA aan geluid. Wederom werd Furmark gebruikt om de gpu aan het werk te zetten, waarna een temperatuur van wel 92 graden werd gemeten. De koeler draaide daarbij op vol vermogen en produceerde daarbij 59,4dBA aan geluid. De kaart is dus stiller dan de HD 4890's, maar groot is het verschil niet.

Energie

Energie

De hoge temperatuur en de snelheid waarmee de fans rond moesten draaien zijn niet vewonderlijk, aangezien in Furmark het stroomverbruik van de HD 4890's van 239W naar maar liefst 600W opliep. Daar moet bij gezegd worden dat dit het vermogen is dat uit het stopcontact getrokken werd: de voeding, die ruwweg een rendement van 80 procent zal hebben, geeft dan pakweg 500W aan de verschillende onderdelen door.

Overigens kan het idle-verbruik eenvoudig omlaag gebracht worden door het geheugen onder te klokken. Dat levert per videokaart al gauw een besparing van 20W op. Het is jammer dat AMD het blijkbaar niet voor elkaar kreeg om de geheugenklok automatisch naar de minimale waarde van 490MHz te verlagen.

De GTX heeft de CrossFire-opstelling van de HD 4890's tuk als het gaat om energieverbruik. In idle-modus wordt slechts 173W verbruikt: net zoveel als een enkele HD 4890. In Furmark werd uiteindelijk een stroomverbruik van 452,8W gemeten, wat goed overeenkomt met het verbruik dat tijdens de benchmarks werd waargenomen. Zowel idle als onder load verbruikt de GTX295 dus aanzienlijk minder dan twee HD 4890's.

Vermogensopname (W)

|

| 2x HD4890 - load |

600 600 |

| 2x HD4890 - idle |

239 239 |

| GTX295 - load |

453 453 |

| GTX295 - idle |

173 173 |

Om alles in perspectief te zetten werd ook naar het stroomverbruik gedurende de verschillende benchmarks gekeken. Het hoogste vermogen dat met twee HD 4890's werd gemeten lag rond de 500W. Met een dergelijke configuratie kan er dus van worden uitgegaan dat er tijdens het gamen ruwweg 500W verstookt zal worden.

Conclusie

:fill(black)/i/1238682913.jpg?f=thumb)

:fill(black)/i/1238682915.jpg?f=thumb)

:fill(black)/i/1238682917.jpg?f=thumb)

:fill(black)/i/1238682918.jpg?f=thumb)

:fill(white)/i/1239879052.jpeg?f=thumb)

:fill(white)/i/1239879053.jpeg?f=thumb)

:fill(white)/i/1239879054.jpeg?f=thumb)

:fill(white)/i/1239879055.jpeg?f=thumb)

:fill(white)/i/1239879056.jpeg?f=thumb)

:fill(white)/i/1240130018.jpeg?f=thumb)

:fill(white):strip_exif()/i/1238579312.jpeg?f=thumbmedium)

:fill(white):strip_exif()/i/1231537406.jpg?f=thumbmedium)

/i/1249739662.png?f=fpa_thumb)

/i/1246797829.png?f=fpa_thumb)

/i/1242134496.png?f=fpa_thumb)

:strip_icc():strip_exif()/i/1240813501.jpeg?f=fpa_thumb)

:strip_icc():strip_exif()/i/1238686233.jpeg?f=fpa_thumb)